エージェント型AIの新たなフロンティアを切り拓くNVIDIA Vera Rubin

AIが私たちの生活にますます深く関わるようになる中で、「エージェント型AI」という言葉を耳にする機会も増えてきました。NVIDIAの「Vera Rubinプラットフォーム」は、まさにこのエージェント型AIの未来を大きく変える可能性を秘めています。これは、事前トレーニングから推論まで、AI開発の全段階を最適化し、構成可能なAIインフラで世界最大規模のAIファクトリーを拡張するために設計された、画期的なプラットフォームなんです。

NVIDIAの創業者兼CEOであるジェンスン・フアン氏も「Vera Rubinは、世代を超えた飛躍です。画期的な7つのチップ、5つのラック、1つの巨大なスーパーコンピューターが、AIのあらゆる段階を支えるために構築されています。Vera Rubinがけん引する史上最大のインフラ構築を開始したことで、エージェント型AIの転換期が到来しました」と語っています。この言葉からも、今回の発表がいかに大きな意味を持つかが伝わってきますよね。

AIの進化を支える7つの新しいチップ

NVIDIA Vera Rubinプラットフォームの中核をなすのは、7つの新しいチップたちです。これには、NVIDIA Vera CPU、NVIDIA Rubin GPU、NVIDIA NVLink™ 6 Switch、NVIDIA ConnectX®-9 SuperNIC、NVIDIA BlueField®-4 DPU、NVIDIA Spectrum™-6 Ethernet スイッチ、そして新たに統合されたNVIDIA Groq 3 LPUが含まれます。これらのチップが協力し合うことで、まるで一つの巨大なAIスーパーコンピューターのように機能し、私たちが想像する以上の複雑なAIタスクをこなせるようになるんです。

AnthropicやOpenAIといったAI分野をリードする企業も、このプラットフォームに大きな期待を寄せています。彼らのコメントからは、NVIDIA Vera Rubinが、より高性能なAIモデルの開発や、ユーザーに信頼性の高いサービスを提供するための基盤となることが伺えます。

PODスケールシステムでAIインフラが進化

AIインフラは、単体のチップやサーバーから、複数のラックを統合した「PODスケール」という考え方へと急速に進化しています。これは、スタートアップ企業から大企業、公的機関まで、あらゆる規模の組織がAIをより効率的かつ高性能に利用できるようになることを意味します。私たち一人ひとりがAIを学ぶ上で、このようなインフラの進化は、より高度な学習環境やツールへのアクセスを可能にし、学習の可能性を大きく広げてくれることでしょう。

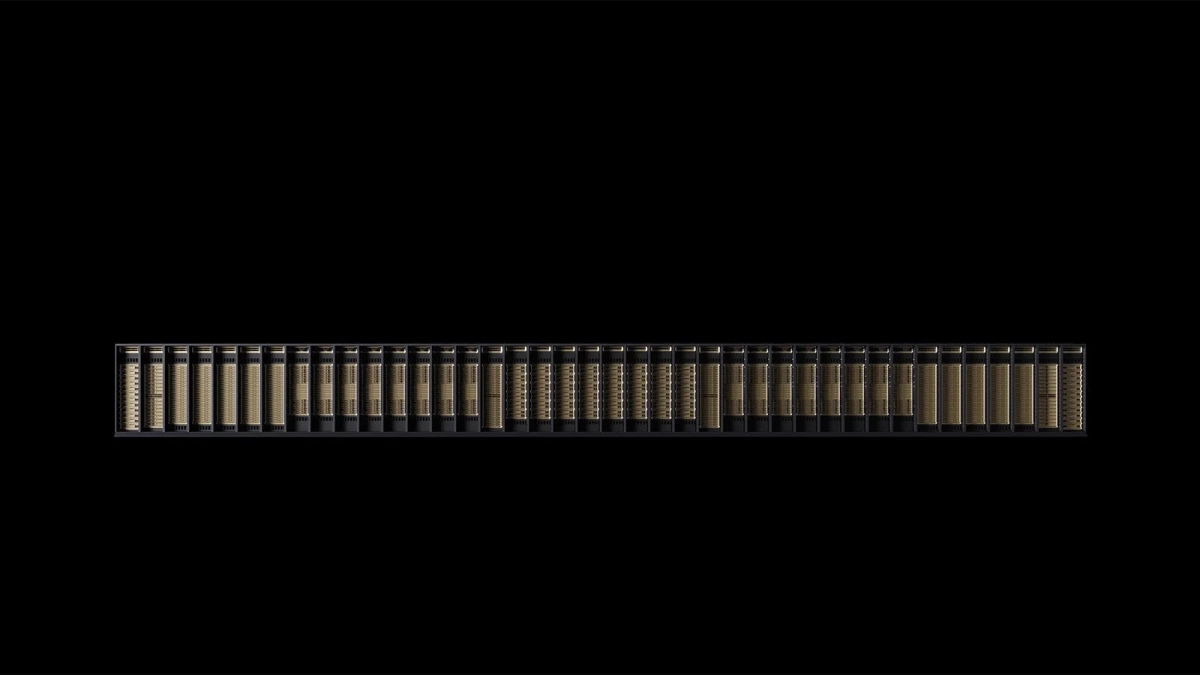

NVIDIA Vera Rubinプラットフォームは、以下の5つのラックによって構成されています。

NVIDIA Vera Rubin NVL72 ラック

このラックは、72基のRubin GPUと36基のVera CPUなどを統合し、驚くほどの効率性を実現しています。以前のプラットフォームと比較して、GPUの数を4分の1に抑えながらも、大規模なモデルのトレーニングコストを10分の1に削減し、推論スループットを最大10倍に向上させると言われています。これは、AI開発におけるコストとパフォーマンスの常識を覆すような進化ですね。

NVIDIA Vera CPU ラック

エージェント型AIのワークロードでは、AIモデルが生成した結果を検証するために、たくさんのCPUベースの環境が必要になります。Vera CPUラックは、最大256基のVera CPUを統合し、拡張性とエネルギー効率に優れた処理能力を提供します。従来のCPUよりも2倍効率的で50%高速化されることで、大規模なエージェント型AIの実現を強力に後押しします。

NVIDIA Groq 3 LPX ラック

低レイテンシと大規模なコンテキスト処理が求められるエージェント型システムのために設計されたのが、NVIDIA Groq 3 LPXです。Vera Rubinと連携することで、1兆パラメータモデルにおいて、メガワットあたりの推論スループットを最大35倍向上させ、収益機会を最大10倍に拡大する可能性があります。これは、超大規模なAIモデルがより身近になる未来を示唆しています。

NVIDIA BlueField-4 STX ストレージ ラック

AIネイティブなストレージインフラであるBlueField-4 STXは、AIモデルが生成する膨大なデータを効率的に保存・取得するために最適化されています。NVIDIA DOCA Memos™という新しいフレームワークにより、推論スループットを最大5倍向上させ、電力効率も大幅に改善されます。これにより、AIエージェントとの高速な対話や、よりスケーラブルなAIサービスが実現し、私たちもよりスムーズにAIを活用できるようになるでしょう。

BlueField-4 STXストレージの詳細はこちら:https://nvidianews.nvidia.com/news/nvidia-launches-bluefield-4-stx-storage-architecture-with-broad-industry-adoption

NVIDIA Spectrum-6 SPX Ethernet ラック

AIファクトリー全体のデータトラフィックを高速化するために設計されたのが、Spectrum-6 SPX Ethernetです。低レイテンシで高スループットのラック間接続を大規模に実現し、コパッケージドオプティクスを搭載することで、光電力効率を最大5倍、レジリエンスを10倍向上させます。これにより、AIシステム全体の安定性と効率が飛躍的に向上します。

エネルギー効率とレジリエンスの向上

NVIDIAは、AIファクトリー全体の動的な電力プロビジョニングを可能にするDSX Max-Qを含む新しいDSXプラットフォームを発表しました。これにより、データセンターの電力供給制限がある場合でも、AIインフラの展開を30%増加させることができます。さらに、DSX Flexソフトウェアは、AIファクトリーを電力網にとって柔軟な資産へと変え、未活用だった100ギガワットもの電力を開放する可能性があります。これは、AIの持続可能な発展に大きく貢献する、素晴らしい取り組みですね。

また、協調設計されたAIインフラのブループリントであるVera Rubin DSX AI Factory リファレンス デザインも公開されました。これにより、エネルギー効率が向上し、AIファクトリーが常に高い負荷で稼働しながらも確実に拡張できるようになります。

広がるエコシステムサポート

NVIDIA Vera Rubinベースの製品は、今年後半に主要なクラウドプロバイダー(Amazon Web Services、Google Cloud、Microsoft Azure、Oracle Cloud Infrastructureなど)や、グローバルなシステムメーカー(Cisco、Dell Technologies、HPE、Lenovo、Supermicroなど)から提供開始される予定です。

-

Crusoe: https://www.crusoe.ai/resources/newsroom/crusoe-expands-nvidia-collaboration

-

Nebius: https://nebius.com/newsroom/nebius-introduces-managed-ai-factories-powered-by-nvidia

-

Nscale: http://www.nscale.com/press-releases/nscale-nvidia-vera-rubin

-

ASUS: https://www.asus.com/event/asus-ai-pod-nvidia-vera-rubin-nvl72/

AIラボやモデル開発者も、このプラットフォームを活用して、より大規模で高性能なモデルを開発し、低レイテンシで長文コンテキストのマルチモーダルシステムを提供することを目指しています。

私たちの未来とAI学習への期待

NVIDIA Vera Rubinプラットフォームの登場は、AIの進化が止まらないことを改めて教えてくれます。一見、専門的で難しそうに感じるかもしれませんが、このような最先端の技術が、私たちの暮らしや仕事、そして学びのあり方を大きく変えていくことは間違いありません。AIがより賢く、よりパワフルになることで、これまで解決できなかった社会課題が解決されたり、新しいサービスやエンターテイメントが生まれたりするかもしれません。

自己学習を考えている皆さんにとって、このような技術の進化は、新しい知識を習得する絶好のチャンスです。AIの基礎を学ぶことはもちろん、エージェント型AIがどのように私たちの生活に統合されていくのかを理解することは、きっと未来を読み解く大切な鍵となるでしょう。今回の発表は、AIの無限の可能性と、それに伴う私たちの学びの重要性を再認識させてくれる、そんな温かいメッセージのように感じられますね。

NVIDIAについてもっと知りたい方はこちら:https://www.nvidia.com/ja-jp/